JFrog บริษัทผู้ให้บริการซอฟต์แวร์ด้าน CI/CD ออกรายงานความปลอดภัย เตือนปัญหาการแพร่กระจายโมเดล LLM ที่แอบฝังมัลแวร์หรือ backdoor เผยแพร่ผ่านเว็บไซต์กลางอย่าง Hugging Face

ปัญหาการเผยแพร่ซอฟต์แวร์ที่แอบฝังมัลแวร์บนเว็บไซต์ซื้อขายแลกเปลี่ยนแพ็กเกจซอฟต์แวร์ หรือที่เราเรียกว่า supply chain attack มีมานานแล้วและรุนแรงขึ้นเรื่อยๆ เช่น กรณีของ PyPI , กรณีของ npm , กรณีของ GitHub ล่าสุดลามมาถึง Hugging Face เว็บไซต์เผยแพร่โมเดล AI ชื่อดัง ตามกระแสโลกเทคโนโลยีเรียบร้อย

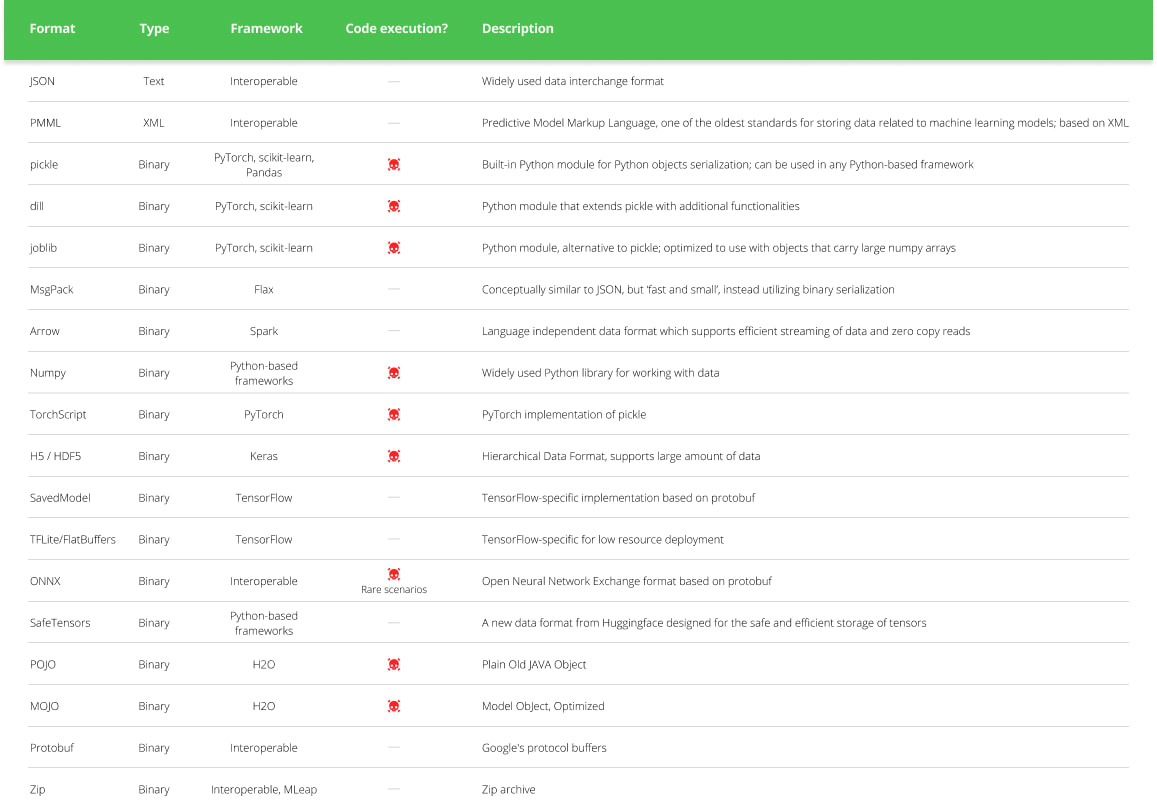

โมเดล AI ที่นิยมใช้กันในปัจจุบันมีฟอร์แมตที่หลากหลาย เช่น JSON, XML แต่ก็มีอีกส่วนที่เป็นไฟล์ไบนารี (เช่น ไฟล์ประเภท pickle ของ Python) ที่ให้แอบฝังสิ่งแปลกปลอมแล้วเกิดการรัน (code execution) ในเครื่องของคนที่ดาวน์โหลดไปรันใช้งาน

Hugging Face เองก็ทราบปัญหานี้ และมีมาตรการความปลอดภัยหลายอย่าง เช่น การสแกนหามัลแวร์ของไฟล์ที่โฮสต์ไว้กับระบบ รวมถึงพัฒนาไฟล์ฟอร์แมตใหม่ชื่อ safetensors ที่ปลอดภัยต่อการแอบยัดไส้

ตัวอย่างการแจ้งเตือนของ Hugging Face

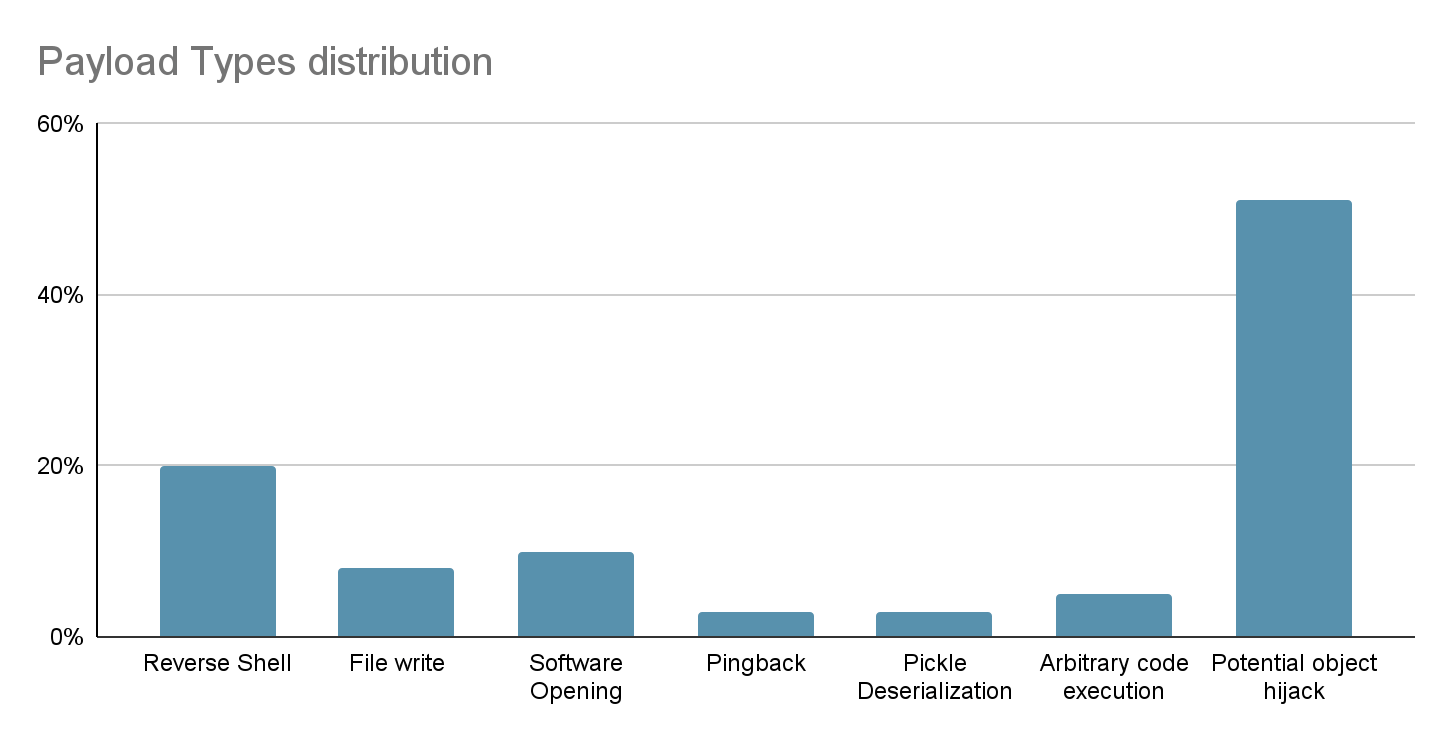

อย่างไรก็ตาม มาตรการป้องกันของ Hugging Face ก็มีข้อจำกัด และถูกเล็ดรอดไปได้ จากการตรวจสอบของ JFrog พบว่ามีโมเดลราว 100 ตัวที่มีความเสี่ยงถูกฝังมัลแวร์หรือโค้ดที่ประสงค์ร้ายมาด้วย โดยไฟล์ที่พบบ่อยเป็นโมเดลของ PyTorch และ TensorFlow ซึ่งเป็นซอฟต์แวร์ยอดนิยมในโลก AI อยู่แล้ว

ตารางแสดงฟอร์แมตไฟล์โมเดล AI แบบต่างๆ

ที่มา - JFrog

Comments

ไฟล์ .ckpt สินะที่ถูกยัดไส้

WE ARE THE 99%