人工知能 ルシファー トロッコ問題

将棋コンピューターと人間との戦い21日(土)のNHK衛星第2放送で「運命の一手・渡辺竜王VS人工知能ボナンザ注目の将棋」(90分)を観た。

掛け値なしに面白い、見甲斐のある番組であった。

この勝負のことを簡単に紹介しておくと、先月21日に品川プリンスホテルで渡辺明竜王(22歳。写真上)と昨年5月の「世界将棋コンピューター選手権」で優勝したソフト「ボナンザ」(スペイン語で大発見の意味)とが一番勝負を闘ったのだ。

下馬評では、渡辺竜王に圧倒的に分があった。

渡辺竜王は知る人ぞ知る勝負強い棋士(中学生で史上4人目のプロ棋士)である。それに対するボナンザは、昨年の「世界将棋コンピューター選手権」に初出場で初優勝。実力は、双方とも折り紙付きである。

さて、この勝負、おいらは竜王の圧勝と予測していたのだが、3時間を越える熱戦となり、竜王が辛くも逃げ切ったのである。

そもそもこのボナンザ開発の経緯が面白い。開発したのは、東北大学大学院理学研究科で理論化学を研究する31歳の学者、保木さん。97年にチェスの神様(世界チャンピオン)がIBMのスーパーコンピューターに敗れたのを知り、自分も将棋のソフトを開発してみようかなと思ったのが始まりという。

このボナンザは只者ではない。過去の対局を江戸時代まで溯り、その戦跡を網羅して読み込んでいる。また、全ての可能性をしらみつぶしにつぶしていくという「全幅検索」という手法により、1秒間に400万の局面を読む(最善の手を探し出す)という人間業ではない勝負強いソフトに仕上がっているのだ。

実際、中盤まではボナンザが優勢であり、竜王が負けを覚悟する場面もあったが、最後はボナンザの凡ミスの一手により、竜王の勝利となった。

おいらの感想。理詰めではコンピューターには絶対にかなわない。しかし、今のコンピューターに大局観はない。また、過去になかった打ち方には滅法弱い。だからプロが勝つ。

ところが、そうは云っても、恐らく後数年でコンピューターがプロの棋士を破る日がくるのは間違いない。それは、大局観のあるコンピューターの出現か、大局観がないにもかかわらず、理詰めの権化のような化け物コンピューターの誕生を意味するのだ。これは正直怖い世界だと思う。

なお、付言すると、ボナンザの開発者である保木さんの将棋の腕前は全くのアマチュアレベルであるという。そこが面白い。だからこそ、純理論的に開発が可能であったのだと思わざるを得ない。

コンピュータと戦うプロ棋士(前篇)

今年の3月から4月にかけて「第2回将棋電王戦」が開催された。

将棋電王戦とは、プロの棋士にコンピュータが戦いを挑むという将棋のことである。

さて、第1回電王戦は、昨年(2012年)の1月に開催されている。

コンピュータ将棋ソフトである「ボンクラーズ」が元名人である米長邦雄永世棋聖と対戦したのである。そして、そのコンピュータが永世棋聖を破ったのである。

まず、このコンピュータ将棋ソフト「ボンクラーズ」の特徴を述べてみよう。

それは、あらかじめ定跡が打ち込まれている過去のコンピュータソフトとは違い、コンピュータ自身が5万局の棋譜を教科書とし、人間が指しそうな手を自らが学習するというソフトなのである。

これによって、対局中は相手の手を読みながら駒を進めることができ、不利な場面でも最善の対策を取ることが可能となる。

また、相手が最善手を外せば(ミスをすれば)、瞬時に攻撃を開始するというプログラムでもある。

しかし、コンピュータにも弱点はある。

定石から外れた秘策や過去にはない手には弱いのである。

このため、米長永世棋聖は序盤からコンピュータの弱点を突いた秘策を繰り出し、コンピュータに圧勝の様相を見せたが、中盤に形勢を逆転され、最後は敗れることになったのである。

敗れた米長氏は「かつての大名人、大山康晴と戦うようだった」と敗戦の弁を語った。

う~む。これは凄い。

前にもこのブログ(フリーページ「将棋コンピュータと人間との戦い」参照)で、

「理詰めではコンピュータには絶対にかなわない。しかし、今のコンピュータに大局観はない。また、過去になかった打ち方には滅法弱い。だからプロが勝つ。

ところが、そうは云っても、恐らく後数年でコンピュータがプロの棋士を破る日がくるのは間違いない。それは、大局観のあるコンピュータの出現か、大局観がないにもかかわらず、理詰めの権化のような化け物コンピュータの誕生を意味するのだ。これは正直怖い世界だと思う」

と書き込んでいるが、どうやらそうなってしまったのだろうか(この項続く)。

コンピュータと戦う棋士(中篇)

続いて、今年(2013年)の「第2回将棋電王戦」である。

第2回電王戦は第1回と異なり、プロ棋士5人とソフト5本との一斉対局に変更された。

3月23日から週に1対局ずつ、5週に渡って行われることになったのである。

プロ側のメンバーは、阿部光瑠四段、佐藤慎一四段、船江恒平五段、塚田泰明九段、三浦弘行八段(対局順)である(写真は三浦弘行八段)。

対するコンピュータは、第22回世界コンピュータ将棋選手権(2012年5月開催)で1位から5位となった5ソフトである。

そして、その結果は、第1局の阿部四段以外コンピュータに勝てなかったのである。

トータルでの結果をおさらいすると、プロ棋士の1勝3敗1引き分けであった。第2局の佐藤4段がプロ棋士として初めて負けると、第3局では、あの天才棋士、船江五段も184手で敗れるのである。

第4局では塚田九段が引き分け(持将棋は引き分けと云うルールによる)とするものの、第5局でも三浦八段がコンピュータソフトに敗れるのであった。

これは一体どういうことだろうか。

2007年の渡辺竜王対ボナンザ戦で、後数年もしたらコンピュータソフトが勝つと予測したとおりになった訳だが、その原因は何だろう。

「将棋世界」元編集長で作家の大崎善生氏は、コンピュータが「疲れない、間違えない、後悔しない」ことを強調しておられる。

昔のコンピュータは間違えたが、今のコンピュータは間違えないのである。

それに対して、プロ棋士といえども人間である。一手でも間違えてしまえばコンピュータに負けるし、人間だから間違えることもある。棋士にとって、一手でも間違えてはいけないというプレッシャーは予想以上のものだろう。

しかも、コンピュータは疲れないばかりか、後悔するという感情を持ち合わせていないのである。性質(たち)が悪い(この項続く)。

コンピュータと戦う棋士(後篇)

ここで、将棋と似て非なるチェスの世界に目を転じてみよう。

チェスの世界では、2005年ごろから既にコンピュータが人間を破って久しいのである。

しかも、世界チャンピオンの決定戦は、人間抜きでコンピュータソフト同士が戦うという有様である。

考えてみれば、駒の数が相対的に少なく、駒の果たす役目が比較的複雑でなければ、理詰めにおいてコンピュータの得意な演算能力が発揮されるチェスでは人間が機械に勝てる訳がない。

考えようによっては、スーパーコンピュータはそのために開発されたも同様である。

それが今度は将棋である。

将棋の世界もチェス同様、コンピュータが駒の数とルールを覚え、定石はもとより、1手打つ場合の対応を瞬時に演算すれば、その実力が存分に発揮されるはずである。

つまり、将棋の世界でコンピュータソフトが強くなるにはそれなりの理由があるのだ。

では、麻雀はどうか。

麻雀は、俗に運7割、技3割という。天和(テンホー)などは配牌で決まってしまうのだから、運10割である。

したがって、麻雀の場合は、コンピューターは確かに強いだろうが(手持ちの牌と場に出ている牌から上がり役の可能性や、対戦相手からリーチされた場合の待ちの読みなどはかなりの確率で的中する可能性はある)、運に左右される場合もあるだろうし、勝負の流れにはコンピュータといえども逆らえないはずである。

これをつき進めれば、究極の戦いは丁半博打だろう。

丁か半かの確率2分の1の世界で、コンピュータが頑張っても勝つ確率の2分の1が変わる訳ではない。

つまり、いくらコンピュータが精度を上げたとしても所詮は演算能力である。

これを要するに、人工知能だと銘打っても、人間の知能には遠く及ばないということである。

だが、そうは云っても、全く違うタイプのコンピュータが出現して、人工知能となる日が来ないとは限らない。

極端な話し、長嶋茂雄氏のように「勘の鋭い」コンピュータが出現するかも知れない。そういうコンピュータは勝負に強いはずである。

SFの世界だけだと思っていても、そういう日が来るのは遠くない未来かも知れない。

とすると、こりゃ、やはり怖い世界じゃのぅ(この項終わり)。

人工知能が銀行員に(前篇)

過日、電王戦でプロの棋士がコンピューター(人工知能)に3勝2敗と勝ち越しを決めたというニュースを見た。

これまで人工知能にめっぽう弱かったプロ棋士(過去通算わずか2勝)が今回は秘策(禁じ手もどき?)を使ったとはいえ、勝利したことはエポックである。

この電王戦については本ブログのボナンザで書いているので、再掲はしないが(フリーページ「人工知能と人間との戦い」参照)、今回云いたいのは人工知能が某都銀の行員になることが内定したことについてである。

いよいよ来たか、である。

将棋に勝つことができる人工知能である。銀行のルーティン業務の場合、プログラムの開発とデータの入力さえしていれば、人工知能が銀行員の代わりをやっても不思議ではない。

ネタをばらすと、今回の人工知能の業務とは「三井住友銀行コールセンター」の対応業務である。

ただし、この業務をバカにしてはいけない。

例えば「ATMの手数料を教えてくれ」という質問があったとしよう。

実は、この質問の回答は思ったほど容易ではない。

何故なら手数料には、現金引き出しの手数料もあれば振り込み手数料もある。また、使うキャッシュカードは自行か、他行かによっても手数料は異なる。そしてATMが自行のものか、他行のものかによっても回答は変わるなど幾通りもの回答が考えられるのである。

銀行のオペレーターであってもこれらの項目を聞き出しながら回答をしなければならないという厄介な質問である。

これらの質問に対して、今までのオペレーターは経験則的に回答をしていたが、それでも必要に応じてマニュアルを参照しながら回答する必要があった。

ところが、今回の人工知能を導入することによって、オペレーターが質問事項をキーボードに入力すると、モニター画面に人工知能による回答候補が瞬時に出でくるようになるという。

この回答は有力回答順に並び、しかも、その確率まで表示する。オペレーターは人工知能による候補と確率を参考にしながらお客と電話対応をすることができるという優れものである(この項続く)。

人工知能が銀行員に(後篇)

さて、オペレーターは、人工知能による回答候補と確率を参考にしてお客と電話対応さえすれば良いということになる。

この秘密を解く鍵は、プログラム作りにあたって、回答を絞り込むための専門用語をキーワードとしたことにある。

もともと膨大な事務処理の質疑応答集を人工知能に覚えさせ、その上で質問の多い外貨預金や両替、手数料などの専門用語(キーワード)を選び出すので、正答率が高まるのである。

しかも、人工知能には学習効果が付与されている。お客への回答が正しかった場合にはオペレーターが「役立ちボタン」を押すルールとなっており、このルールによって人工知能は学習し、これを繰り返すことによって正答率がさらに高まるという。

では、人工知能と人間との勝負をしたらどちらが勝つのだろうか。

この銀行では3カ月間に渡る技術検証を行い、応対スピードをストップウオッチで測定したところ人工知能と人間とでは五分五分の結果が出たという。

う~む、五分五分かぁ。

開発初期の段階で既に五分五分ということはそのうちコンピューターが圧勝するのではないだろうか。そうだとすれば、特に銀行内部の事務処理などはそのうち全てが人工知能の処理になることも予測される。

いや、考えてみれば財務諸表を分析するなどはもともと人工知能の得意分野である。

融資申込書の必要項目などの信用情報に加え、過去の入手金データ、取引先との取引データなどを人工知能が分析してしまえば銀行員は不要になる時代が来てもおかしくはない。

文化系の専権業務であった融資業務が人工知能に変わる時代の人間は何をしているのだろうか。ソラオソロシイがいずれ現実となることもありうるだろう。

しかも、銀行が導入するのであれば、次は生保と損保である。紙と人とで成り立っている仕事は、人工知能に席巻されてしまう可能性もある。なお、日本郵政(かんぽ生命)は保険金支払業務を人工知能で活用すると既に発表している。

いよいよ「2001年宇宙の旅」の光あれば影あり?の世界が現実味を帯びてきたのぅ。

なお、付言するとこの人工知能は日本語を理解する米IBMの認知型コンピューター「ワトソン」だそうだ。ワトソン君、恐るべし(この項終わり)。

ロボットの未来(前篇)

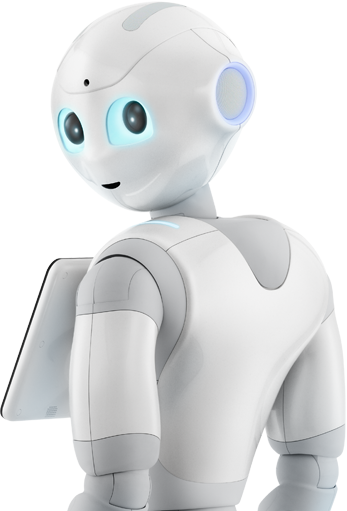

旧聞に属するが、ヒト型ロボット「ペッパー」(ソフトバンク製)の開発者として知られる林氏が今年9月にソフトバンクモバイルを退社された。

ロボットの開発者がその会社を辞めるのだから、尾ひれがつく。孫社長とケンカ別れではないかと一時はネットでも噂になったほどである。

その真相は不明だが、開発方針のギャップが引き金だという説もある。

孫社長は「早く鉄腕アトムを開発しろ」と云うのに対し(云うだろうなぁ)、林氏は現在の最新のAI(人工知能)技術でも新生児レベル以下のため、時間軸の差が理由の一つだったというのである。

ところで、林さんってどういう人だろうかというと、林要(はやし かなめ)氏は98年に都立科学技術大学(現首都大学東京)大学院を修了しトヨタ自動車に入社。2012年に孫社長にスカウトされ、ソフトバンクモバイルに転職したというエンジニアである(41歳)。

う~む。そういう優秀な人物がソフトバンクを去るのだから、やはり何かあったんだろうなぁ~。

その林さんは今後もAIやロボットの世界で生きるとされており、今後のご活躍を期待するものである。

唐突だが、おいらはロボットの未来を考える場合、軍事面での発達(偵察用ロボ、機雷撤去ロボ、攻撃型ロボなど)と福祉面での活躍(介護ロボ、独居老人の介添えロボ、アイボに代表される癒しロボなど)が期待されると思っている。

また、工場などでのブルーカラーが行う定型作業(ルーティンワーク)は工業用ロボが既に実施しているように、ホワイトカラーの分野でも融資審査などの専門業務はロボットが行うようになるだろう(このブログのフリーページ「思索なるまま『人工知能と人間との戦い』」参照)。

しかし、鉄腕アトムの世界は究極のAIであり、そうなるまでにはまだ気の遠くなるような時間が必要だと考えられている。

だが、ちょっと待って欲しい。チェスや将棋の世界で人工知能がプロに勝つ時代になったことについては、どう考えるべきであろうか(この項続く)。

ロボットの未来(後篇)

ロボットの未来の続きである。

チェスや将棋の世界でコンピュータがプロに勝つ時代になったのである。

また、トヨタや日産などが開発している自動車の自動操縦なども近未来では当たり前のことになろうとしているではないか。

これについておさらいをすると、将棋用のAIは既に人間を圧倒するレベルまでに達している(このブログのフリーページ「思索なるまま『人工知能と人間との戦い』」参照)。

しかし、ここが大事なことだが、将棋用AIはコンピューターのなかに知性を産み出したわけではない。将棋用AIは、いわば巨大な演算装置に過ぎず、将棋以外の処理には向かないのである。

実際、将棋用AIをこれ以上研究しても知性を産み出すことは不可能として、AI研究の対象として将棋用AIは終わったとされているのだ。

その理由は何か。

答えは単純で、将棋が「完全情報ゲーム」だからである。完全情報とは相手と自分の情報が完全に把握されていることを意味する。チェスや囲碁なども完全情報ゲームである。

完全情報ゲームのAIは過去の棋譜などの大量のデータベースを解析し、ある局面になった場合次にどのような手を打つのが最適かを確率的に導き出すソフトである。

だから、データが大量に集まり、解析に時間をかけるほど優れた手を打つことができる。したがって、巨大演算装置(大量の情報を瞬時に処理)が人間に圧勝するのである。

他方で、日常の現実世界において情報が完全に分かっていることなどない。ビジネスや戦争を持ち出すまでもなく、世の中は未知数で満ちている。また、あらゆる状況は刻々と変化する。予定は未定なのだ。これを「不完全情報ゲーム」と呼ぶ。

こういう不完全な情報しかない状況で最適な解を導き出すことは、ほとんど不可能と云ってよい。それは、多岐にわたる推論と無限の場合分けを必要とし、こうした未知数の多い世界での推論は現在のAI水準では不可能である。

だから、現実世界で人工知能が活躍する時代はまだ先のことであると分かるのである。

なお、付言すると、自動車の自動操縦も考え方は完全情報ゲームに近い。車は道路交通法に従う必要があり、目的地に行くこと、人間を快適に運ぶこと、事故を起こさないことなどの定められたルールの中で自動車を動かす技術に過ぎないからである(この項終わり)。

人工知能が小説も

人工知能が囲碁を席巻したのに続き、今度は小説のようである。

読売新聞電子版(16年3月21日)によれば、「人工知能、小説も…人間と共作で文学賞1次通過」との見出しで、人工知能(AI)が人間と共同で「執筆」した短編小説が、国内文学賞の1次審査を通過したとされる。

それによれば、応募した2チームが東京で報告会を開いて発表し、松原仁・公立はこだて未来大教授が代表を務めるチーム「きまぐれ人工知能プロジェクト 作家ですのよ」が、第3回日経「星新一賞」に応募し、1次予選を通過したという。

いよいよ来たか、である。

日経「星新一賞」の応募要項を確認したら10,000字以内と云うから、400字詰め原稿用紙25枚以内の短編ということである。

そう思ってテレビを観ていたら、当日深夜の国営放送「NEWS WEB」でこの特集をやっていた。

その仕組みをざっと説明すると、テーマ、登場人物、プロット(あらすじ)などは、まず最初に人間が決めておくという。

次に、いつ、どこで、誰が、何をするなどの具体的項目については、あらかじめそれぞれの項目に複数の選択肢を用意しておき、人工知能がその選択肢をチョイスしながら、創作していくという手順のようである。

したがって、まだほとんどの内容は人間が創っており、しかも、具体的な創作作業のプログラムは膨大になり、人工知能が創作すると云っても、人間8、人工知能2の割合で創作したことになるという。

今回の応募では、4篇を創作し、そのうちの1作が1次予選を通過したらしい(どの作品かは非公表)。

予選は3次までのようだが、1次予選を通過すると云うのは、一定の水準以上であることは間違いない。それは小説として認められ、作文の域を超えていたということである。

だが、テーマ、登場人物、プロット、プログラムの作り方さえ人間が間違えなければ、人工知能でも「そこそこの小説」が書けるのは当たり前である。パソコンで作る礼状などは、既に「○○子の代筆」などのソフトによって実用化されているのを見れば分かるとおりである。

しかし、ここが肝になるのだが、公募小説で受賞するためには「そこそこの小説」ではダメなのである。それは、どこかで読んだ小説や今まであった小説の物真似にすぎない。そこには、オリジナリティがないのである。そういう作品は、予選を通過しても最終作品には残ることができないのである。

実は、絵でもそうである。

いずれ人工知能の描いた絵が評判になるだろう。偉大な画家と似たような絵を描く人工知能は必ず出現する。しかし、オリジナリティのある絵を人工知能が描くようになるには、本当の人工知能が出現するまでは無理だと思うのである。

だから、おいらは人工知能の書く小説が人間の書く小説を超える時代がそうそう来るとは思えない。それよりも、おいらが書いた小説が賞をとる方が早いのではないかと思う(笑)。いや、これも夢だが。

ルシファー・エフェクト(前篇)

「空気を読む」ということは、どういうことか。

それが、「ルシファー・エフェクト」である。空気を読むということは、何も日本人の特権ではない。

スタンフォード大学で行われた、かの有名な監獄実験の結果を知らされると、普通の人でも簡単に悪魔に豹変することが分かるのである。

ルシファー・エフェクトの意味は、もともとは天使であり、神のお気に入りであったルシファー(写真上は、ルシファーの彫像)が堕落し、悪魔(サタン)になったという逸話から採っている。良い人でも悪魔になり得るという話しである。

少し古いが、この実験は71年にスタンフォード大学心理学部の地下に設けられた模擬監獄で行われた。

この内容は、「スタンフォード監獄実験」の責任者であるフィリップ・ジンバルドーがその全貌を著した本「ルシファー・エフェクト 普通の人が悪魔に変わるとき」に詳細を記している。

実験の内容は、ごくシンプルなものであった。

夏休みに18人の大学生のアルバイトを募るのである。くじ引きで看守役と囚人役に振り分け、2週間にわたって模擬監獄に閉じ込める。そして、刑務所における囚人と看守の心理状態を観察していくのである。

実験に参加したのは、普通の大学生。くじ引きで9名が囚人に、同じく9名が看守に振り分けられた。看守は3名ずつが3交代で勤務にあたり、看守は囚人に暴力をふるってはならないというルールである。

では、この実験の結果はどうなったか。それは、実験の責任者であるジンバルドーでさえも予想しえなかった展開になったのである。

まず、リアリティを出すために現職の警察官に逮捕を依頼した。日曜日、囚人になる学生の住居までパトカーで行き、本当に手錠をかけて監獄まで移送させたのである。

その後、実際の逮捕時同様、全裸で身体検査を受けさせる。学生は囚人服を着せられ、名前でなく番号で呼ばれることになる。

一方、看守役学生にはサングラスの着用が義務づけられた。これによって匿名性が確保されたのである。しかも、学生たちは広告で集められているのでお互いの面識などない。

これが身の毛もよだつルシファー・エフェクトの実験の始まりであった(この項続く)。

ルシファー・エフェクト(後篇)

では、この実験の顛末はどうなったのだろうか。

恐ろしいことに、2日目には早くも囚人には囚人らしさが、看守には看守らしさが身についてしまったのである。早い話しが、囚人は従順に、看守は強権的になったのである。

具体的には、囚人役の学生はあっという間に従順になってしまい、アルバイトだから囚人から離脱する権利があったにもかかわらず、申し出る者は誰もいない。それどころか、看守の顔色を窺い、何かあると手錠をかけてもらうように自ら手を差し出すまでになる。

また、面会に来た家族まで頼まれもしないのに囚人の家族を演じたのである。

一方、看守役もエスカレートしたのである。ハンガーストライキをする囚人が現れたとき、ほかの囚人にまで連帯責任を命じ、さらには囚人たちに性的な行為を真似させるようにまでなったのである。

看守は囚人に暴力をふるってはならないというルールは守られたが、暴力以外の嫌がらせが始まり、それがあっという間に虐待レベルまでになる。

点呼の際などに、ばかばかしいと思われるような命令をする。それに従わない場合には、食事を与えなかったり、腕立て伏せなどの罰を与えてしまう。また、施設のスペースを利用して独房を作り、そこに放り込むことまでするのである。

あまりのリアリティさに4日目になって、囚人役の学生の中にドロップアウトするものが現れた。精神的に不安定になったのである。

この囚人役学生の代わりに、新たに囚人として監獄の様子を見るためのスパイが送り込まれた。しかし、このスパイも役割を忘れ、囚人たちに同化していくという始末であった。

しかし、本当に深刻な問題はそれではなく、実験の責任者であるジンバルドーさえもが実験という空気の中にどっぷりとはまってしまったことである。

ジンバルドーは監獄の様子を常時モニターしていたので、状況の全体像を把握していた。したがって、普通ならドロップアウトする囚人が出現した時点で実験を即刻中止すべきであった(後に、そう述懐している)。

しかし、彼はそうしなかったのである。研究を優先し、心理学の専門家である彼までが囚人と看守役と同じ状況に飲み込まれていったのである。

結局、実験は6日目に中止されることになった。そのきっかけは、初めて見学にきた、ジンバルドーの恋人である女性心理学者があまりにひどい状況を見て直ちに実験を中止すべきだと進言したからである。彼女の進言がなければ実験は継続され、大問題になっていた可能性もある。

以上がルシファー・エフェクトの顛末である。

ここで恐ろしいことは、虐待の首謀者であった看守役の学生は監獄実験の最中でさえ、その役を離れたらごく普通の若者であったということである。

大東亜戦争に陸軍はなぜ突入したのか

ナチスはなぜユダヤ人を毒ガス室に大量に送り込んだのか

三菱自動車はなぜ燃費の偽装工作をし続けなければならなかったのか

など、常軌を逸した行動を考えるには、このルシファー・エフェクトを参考にするとよいのだろうか(この項終り)。

ネット社会の危うさ

ネット社会の危うさと書いたが、そんなに社会的な話しではない。

おいらがブログを書き込もうとして資料収集のためネットを検索したら、金曜日の深夜に突然ネットがダウンしたのである。

おいおい、と思いながら、ネットの供給先?であるモデム(ADSL回線から送られてきたアナログ信号をパソコンへ転送するため、デジタル信号へ変換させる弁当箱のような機器)を見ると再び赤色のランプが点滅している。

おいおい、また壊れちまったのかよぅ。どうやらモデムの不具合のようだが、冗談じゃないよ、この8月に新品に替えたばっかりだよ…。

これはストレスだよねぇ!! パソコンダウンって、突然のことだもんなぁ。パソコンが無用の箱になるもんなぁ。ワードやエクセルが使えてもただそれだけだもんなぁ。

またこのブログが更新できないのかと思いながら、おいらは少々ふてくされる。

だが、応急処置としてモデムの初期化をすればリカバリーできるかも知れないと思い直す。

しかし、今は深夜なので初期化の作業は面倒だ。明日、工具片手にやるしかないかと思いながら、とりあえず、電源を落として10分経過してから再び電源を入れてみるかと、それだけはしてみる。

そうすると、あらフシギ、ランプが緑色に戻ったのである(こういうことは、たまにある)。モデムが生き返ったのである。

パソコンを操作すると、ネットに接続ができた!!

だけどねぇ、冷静に考えればこれはいつ爆発するか分からない時限爆弾と同じだな。いつまたこのモデムがダウンするかも知れないのである。

そう云えば、先日も東京で大停電があったばかりだ。

停電になれば、無論パソコンは無用のものなる。そもそも、それ以前にモデム一つが故障しただけでネットはつながらなくなる。

今の社会システムとは、何と脆弱なことか。

危機管理、おいらも出来ていないが、社会も危機管理が出来ていないような気がするなぁ~。

やっかいなトロッコ問題(前篇)

本日より3日間は、関ネットワークス「情報の缶詰(2017年6月号)」に掲載した「やっかいなトロッコ問題」をお送りします。

やっかいなトロッコ問題

高齢者のアクセルとブレーキの踏み間違い事故が新聞を賑わしている。

その解決策として脚光を浴びているのが自動ブレーキを始めとする自動運転車である。しかし、この自動運転車、バラ色の未来だけとはいかないようだ。

1.自動運転車は人を守るために人を殺すことがある

人工知能が制御する自動運転車は、人間が運転するクルマよりもはるかに安全で、交通事故も大幅に減ることが予測されている。

全世界での交通事故死者数は毎年100万人を超えているが、自動運転車になれば、数え切れないほどの命が救われることになるだろう。

要するに人間は車の運転が下手なのである。

しかし、機械は正確である。しかも、人口知能のプログラムには整合性があり、当然ながら酒に酔ったり、居眠り運転やわき見運転をすることもない。

だが、そのテクノロジーを本当に将来導入すべきかどうかという点については、ちょっと待たなければいけないのだ。その一つが「トロッコ問題」である。

2.人工知能が善悪を判断する

たとえば、あなたが大通りで自動車を走らせているときに突然ブレーキが利かなくなったとしよう。

車は急に止まれなくなったのである。そういう場面で目の前の交差点の信号が赤となり、子どもたちの集団が横断歩道を歩き始めたとしよう。

あなたがこのまま進めば多くの子供たちをひき殺してしまう。さりとて、ハンドルを切って道路から逸脱すれば今度はあなたが死ぬかも知れないのである。

さて、あなたならどうする?(この項続く)

やっかいなトロッコ問題(中篇)

2.人工知能が善悪を判断する(続き)

さて、あなたならどうする?

<子供たちの命を優先する>

道を逸脱し、自らの命を捨てても子どもたちの命を優先する。

<自分の命を優先する>

道にいるのはキャベツだと思い、クルマをそのまま走らせ子どもたちを殺し、自分の命を救う。

恐らくこの頁を読んでいる皆さんは、ほとんどの人が前者の<子供たちの命を優先する>を選択するだろう。

さて、ここで問題なのが、この場合、自動運転車はどちらの選択をするだろうかということである。

皆さんと同じように<子供たちの命を優先する>を選択することになるのだろうか。

しかし、もしそうだとすると、自動運転車の人工知能は子どもたちを救うようにプログラミングされ、同時に運転手であるあなたを殺すようにプログラミングするというパラドックスに直面することになるのである。

3.トロッコ問題

このパラドックスを「トロッコ問題」と呼ぶ。

トロッコ問題とは、英哲学者フィリッパ・フットが提起した「ある人を助けるために他の人を犠牲にすることは許されるか」という哲学的倫理学命題である。

倫理観を揺さぶる思考実験として一躍有名になったトロッコ問題とは、暴走したトロッコの先に5人の作業員がおり、線路を切り替えればその先に1人の作業員しかいないというものである。

このとき、あなたは5人を助けるために線路を切り替え、1人の作業員を殺すか、つまり、5人の命のために1人を犠牲にすることがいいのかという究極の選択を迫られる問題である。

この問題に回答した5千人の結果は、5人の命のために1人を犠牲にしてもいいというのが89%であった。つまり、命の重みを数で解決するという合理主義の考えである(この項続く)。

やっかいなトロッコ問題(後篇)

3.トロッコ問題(続き)

だが、この問題には、次のような派生設問もある。

あなたは線路の上にある橋に立っており、あなたの横にA氏がいる。彼はかなり体重があり、もし彼を線路上につき落として障害物にすればトロッコは確実に止まり5人は助かる。

だが、そうすると彼がトロッコに轢かれて死ぬのも確実である。

彼は状況に気づいておらず自らは何も行動しないが、あなたに対し警戒もしていないので突き落とすのに失敗するおそれは無い。さて、あなたは5人を助けるために彼をつき落とすべきか?

合理主義に基づけば、トロッコを分岐させることも、1人を突き落として脱線させることも1人を死に追いやり5人を助けるという点では同じである。

しかし、多くの人が最初の設問では1人を犠牲にしてもよいとしたのに対し、次の設問では1人を殺すことは許されないと答える(賛成回答者数はわずか11%)。

この2つの設問で異なる点は、最初の設問では行為者の行動自体は「分岐の切り替え」に過ぎないが、次の設問でははっきりと「狙ってA氏をトロッコに激突させる」という行動であり、行為者の直接の意図と行動によってA氏が死ぬということである。

4.誰が自動運転車を買うか

さて、もう一度自動運転車の事例に戻ろう。

この事例では、ほとんどの人が子供たちを助けるために自分の命を犠牲にすることを厭わないだろう。

しかし、自動運転車に乗るということは、そういうケースでは人工知能が搭乗者を殺すというプログラムが仕組まれており、あなたは必ず殺されるのである。そうだと分かっていれば、誰もそんなクルマは買わないのである。

何が云いたいのか。

人工知能がやってくる時代は目の前だ。自動運転車が走るインフラも今後着実に整備されていくだろう。

しかし、こういう人間の抱える根本的な問題が未だに解決されていない(哲学的問題のため、答えはない)のに技術だけが進歩するということは何を意味するのだろうか。

人類を幸福にしようとする未来の技術は、同時に不幸にする要素も孕んでいるのである。

未来は、さて、どうなることやら(この項終り)。

© Rakuten Group, Inc.