กล้องใน Pixel 3 ได้รับเสียงชมเป็นอย่างมาก แม้จะ "ยืนงงในดงกล้องคู่" อยู่ก็ตามที วันนี้กูเกิลก็ออกมาอธิบายว่าเทคนิคการปรับภาพทำให้ภาพที่ได้มีความละเอียดสูงมากแม้จะใช้กล้องเดี่ยวนั้น อาศัย "ภาพสั่น" กลายเป็นตัวทำให้ได้ภาพความละเอียดสูงขึ้นได้อย่างน่าแปลกใจ

เทคนิคการเพิ่มความละเอียดภาพให้สูงกว่าตัวเซ็นเซอร์ หรือที่เรียกว่า drizzle นั้นเป็นเทคนิคในวงการภาพดิจิตอลมานานนับสิบปีแล้ว โดยอาศัยการรวมภาพที่เขยี้ยนห่างกันเล็กน้อย ทำให้ส่วนของเซ็นเซอร์รับภาพต่างกัน และสามารถนำภาพกลับมารวมกันกลายเป็นภาพความละเอียดสูง แต่การทำเช่นนี้ที่ผ่านมาต้องอาศัยวัตถุหยุดนิ่ง กล้องถูกขยับอย่างแม่นยำ

กูเกิลอาศัยการสั่นไหวของมือผู้ถ่าย แล้วแอบถ่ายภาพเป็นชุดแทนที่จะถ่ายภาพเดียว จากนั้น นำภาพมาวางให้ตรงกัน (align) เพื่อรวมภาพให้ได้ความละเอียดสูงขึ้น แนวทางนี้ทำให้กล้องใน Pixel 3 นั้น ต่อให้ผู้ใช้วางกล้องอย่างนิ่งสนิท ตัวเลนส์ OIS ก็จะพยายามขยับภาพให้สั่นเล็กน้อยเพื่อให้นำภาพมาเพิ่มความละเอียดได้

อัลกอริทึมรวมภาพของกูเกิลนั้นเหนือกว่าอัลกอริทึมอื่น เพราะ

- กระบวนการรวมภาพจะคิดถึงขอบของวัตถุในภาพด้วยเสมอ ทำให้เมื่อถึงจุดตัดระหว่างวัตถุ อัลกอริทึมไม่จับสีมารวมกันจนภาพเบลอ

- อัลกอริทึมรับรู้ว่ามีวัตถุเคลื่อนไหวความเร็วสูงอยู่ในภาพ เมื่อไม่สามารถรวมภาพได้ในบางจุด ก็จะละเว้นไป ตรงนี้จะทำให้ภาพมี noise สูงในบางจุดที่มีการเคลื่อนไหว แต่คุณภาพภาพโดยรวมก็ยังดีขึ้นมาก

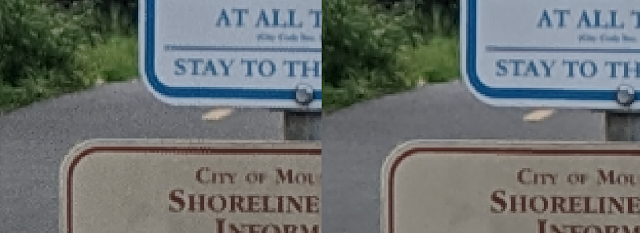

ภาพป้ายถนน Pixel 3 ว่าตรงไหนคือขอบป้าย และไม่สีถนนมารวมกับตัวป้าย ทำให้ขอบป้ายไม่เบลอรวมมาหลายภาพ

ภาพรถกำลังเคลื่อนที่ เนื่องจากภาพต่างกันเกินไป อัลกอริทึมใน Pixel 3 จะไม่รวมภาพส่วนที่เป็นรถ โดยยอมใช้ภาพคุณภาพจำกัดจากเฟรมเดียว

ที่มา - Google AI

Comments

Pixel 4 ก็น่าจะกล้องหลังตัวเดียวเหมือนเดิม เพราะ Pixel 3 นี่ก็ยังไม่ได้ใช้ เซนเซอร์ตัวล่าสุดของ Sony

ใช้ของถูกก็ยังเมพจนคู่แข่งสู้ไม่ได้ จะเปลืองทำไม - กูเกิลไม่ได้กล่าวไว้

lewcpe.com , @wasonliw

software นี่โคตรโหดเลย ยอม

เข้าไปอ่านมา รู้สึกจะใช้หลักการ pixel shift แบบเดียวกับกล้องสินะครับ

แต่เหมือนจะแค่ขยับหนึ่งพิกเซลสี่ทิศเหมือน Pentax ไม่ได้ขยับครึ่งพิกเซลแปดทิศ(เพื่อเพิ่ม res)เหมือน Olympus แฮะ

ทั้งนี้กล้องต่างๆมีข้อเสียตรงที่ว่ากล้องต้องนิ่งวัตถุต้องนิ่ง แต่ถ้า google เอา ai มาช่วยให้รวมภาพได้ดีขึ้นได้ก็สุดยอดเลย

ส่วน Sony เป็นเจ้าของเซนเซอร์แท้ๆ แต่ดันสู้ไม่ได้...

น่าสงสารเค้านะครับ

มันมี Pixel Visual Core Chip ที่เป็น Custom image processor เพิ่มตัวนึงด้วยนะครัช ไม่ใช่ software เฉยๆ

คืออย่างกล้องจริงๆมันก็มีชิพประมวลผล Sony ก็ทำกล้องอยู่แล้ว เซนเซอร์ก็ของตัวเอง ก็น่าจะรู้ไส้รู้พุงมากกว่านี้นะครับ

สาวก Sony จะบอกว่าให้ปรับ mode manual สิ สรุปคือโหมด auto ดันห่วย

ถ้าคุณเป็นคนที่เก่งมากๆ ด้าน Software/Customs Chip แทบจะที่สุดในโลกแล้ว คุณไม่อยู่ Sony หลอกครับ มันไร้อนาคต

Pixel 2 ถ้าอัปเดตกล้องก็น่าจะทำได้เหมือนกันหรือเปล่าครับ เพราะดูแล้วเป็นเรื่อง software ล้วนๆ

บางอย่างใช้ชิพ Visual Core ตัวใหม่ด้วยครับ

เขยี้ยน=>เขยื้อน

ดิจิตอล => ดิจิทัล

เขยี้ยน => เขยื้อน

ไม่สีถนน ?

ชาบู ให้กับเรื่องนี้เลย ^^

Sony : how to capture things.

Google : how to improve things that Sony captured.

Samsung : captures Google.